python爬取百度贴吧前1000页内容(requests库面向对象思想实现)

此程序以李毅吧为例子,以面向对象的设计思想实现爬取保存网页数据,暂时并未用到并发处理,以后有机会的话会加以改善

- 首先去百度贴吧分析贴吧地址栏中url后的参数,找到分页对应的参数pn,贴吧名字对应的参数kw

- 首先创建类,写好__init__方法,run方法,__init__方法里先可以直接写pass

- run方法里大概整理一下整体的思路

- 构造 url 列表,因为要爬取1000页,每页需对应一个url

- 遍历发送请求,获取响应

- 保存

- 将可封装的步骤封装到单独的方法,所以这里又增加了三个方法

- get_url_list方法可以返回需要访问的所有url的一个列表

- parse_url方法用来发送请求获取响应,最终返回html页面内容

- save_html方法用来保存html字符串

- run方法为核心实现,将三个方法和用到的参数结合起来

- 每当有用到的参数,可以在__init__方法里添加对应的实例属性

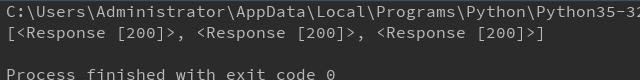

- 最后,实例化类,测试,会不断的向当前目录保存html文件

import requests

class TiebaSpider(object):

def __init__(self, tieba_name): # tieba_name为要爬取贴吧的名称

self.tieba_name = tieba_name

self.url_temp = 'https://tieba.baidu.com/f?kw=' + tieba_name + '&ie=utf-8&pn={}'

self.headers = {

'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/75.0.3770.100 Safari/537.36',

}

def get_url_list(self): # 构造url列表

# url_list = []

# for i in range(1000):

# url_list.append(self.url_temp.format(i * 50))

# return url_list

return [self.url_temp.format(i*50) for i in range(1000)] # 列表推导式替换上面代码

def parse_url(self, url): # 发送请求,获取响应

print(url)

response = requests.get(url, headers=self.headers)

return response.content.decode()

def save_html(self, html_str, page_num): # 保存html字符串

file_path = '{}-第{}页.html'.format(self.tieba_name, page_num)

with open(file_path, 'w', encoding='utf-8') as f: # 样例: 李毅-第一页.html

f.write(html_str)

def run(self): # 实现主要逻辑

# 1.构造url列表

url_list = self.get_url_list()

# 2.遍历,发送请求,获取响应

for url in url_list:

html_str = self.parse_url(url)

# 3.保存

page_num = url_list.index(url) + 1 # 页码数

self.save_html(html_str, page_num)

if __name__ == '__main__':

tieba_spider = TiebaSpider('李毅')

tieba_spider.run()

以上就是本文的全部内容,希望对大家的学习有所帮助,也希望大家多多支持【听图阁-专注于Python设计】。